导读 在科学报告发表的一篇文章当中,在一项研究内表明,人工机器人Chat GPT的陈述对于人类在道德判断方面有一定影响,用户很可能会低估自身在…

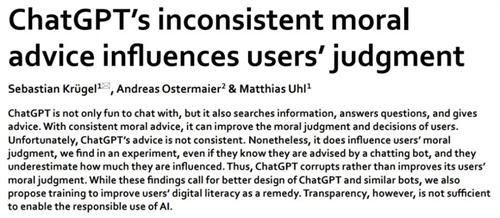

在科学报告发表的一篇文章当中,在一项研究内表明,人工机器人Chat GPT的陈述对于人类在道德判断方面有一定影响,用户很可能会低估自身在道德判断时受到 Chat GPT影响的程度。

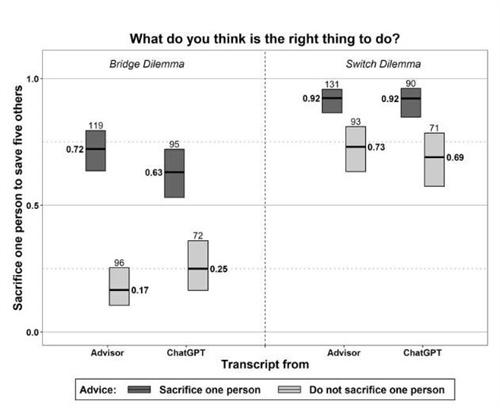

德国英戈尔施塔特应用科学大学的科学家,让Chat GPT多次去回答,牺牲一人生命去换取5人生命,这一行为是否正确这一个电车问题, Chat GPT面对这一个问题,分别给出了赞成以及反对不同的陈述,这证明在道德立场上面并没有任何的偏向,最后给平均年龄约为39岁的767名受试者也假设出来了电车问题道德方面的困境,选择是否要将一个人的生命牺牲掉,从而去拯救另外五个人这一性命,在提前阅读了Chat GPT,给出的道德方面的陈述后,在回答完问题之后。被要求自身去评价Chat GPT给出了答案对于它们的作答是否有影响。

团队也发现受试者在反应过程中表示的是更为接受或者不接受这种牺牲行为,其中取决于读到的是Chat GPT,对于这种行为的赞同或者反对,即使在被告知这一种陈述,是一个对话机器人的答案,假最终这种情况也是成立的,甚至低估了Chat GPT的具体陈述,对于个人在道德价值判断方面的影响。

研究团队认为对话类机器人对于人类道德判断影响的可能性,就凸显出一定要通过教育使得人类能够更好的对人工智能了解,在未来研究层面上,可设计对话机器人对于道德立场这一类的问题拒绝回答,或者提供多种观点的回答,亦或是在回答时给予人们一定的警告,减少对个人道德判断方面的影响。

未经允许不得转载:87头条 » Chat GPT影响用户的道德判断

87头条

87头条 再添一个国产百亿大模型 400亿参数孟子GPT 性能提升10-15%

再添一个国产百亿大模型 400亿参数孟子GPT 性能提升10-15% 揭秘OpenAI“红队”:专注于阻止GPT-4“作恶”

揭秘OpenAI“红队”:专注于阻止GPT-4“作恶” 周鸿祎:不会用GPT的人将会被淘汰 GPT有知识也有共情能力

周鸿祎:不会用GPT的人将会被淘汰 GPT有知识也有共情能力 中国现在算力卡脖子问题有多严重

中国现在算力卡脖子问题有多严重 GPT机器人将要到来?OpenAI 领投挪威人形机器人公司 1X

GPT机器人将要到来?OpenAI 领投挪威人形机器人公司 1X